特征缩放 是一种在固定范围内标准化数据中存在的独立特征的技术。它是在数据预处理期间执行的。

工作: 给定一个具有特征的数据集- 年龄 , 薪水 , BHK公寓 每个人拥有5000个独立的数据特征。

每个数据点标记为:

- 是的 (指具有给定的 年龄 , 薪水 , BHK公寓 功能价值(可购买房产)

- 第二类-没有 (指具有给定的 年龄 , 薪水 , BHK公寓 功能价值(买不起房产)。

通过使用数据集来训练模型,我们的目标是建立一个模型,该模型可以预测人们是否可以购买具有给定特征值的房产。

一旦对模型进行了训练,就可以创建一个包含给定数据集数据点的N维(其中N是数据集中存在的特征数)图。下图是模型的理想表示。

![图片[1]-ML |特征缩放-第1部分-yiteyi-C++库](https://www.yiteyi.com/wp-content/uploads/geeks/20210601/geeks_Feature.jpg)

如图所示,恒星数据点属于 1类——是的 圆圈代表 第二类——没有 标签,然后使用这些数据点对模型进行训练。现在给出了一个新的数据点(如图所示的菱形),它对3个特征具有不同的独立值( 年龄 , 薪水 , BHK公寓 )如上所述。该模型必须预测该数据点是否属于“是”或“否”。

预测新数据点的类别: 该模型计算该数据点与每个类别组的质心之间的距离。最后,该数据点将属于该类别,该类别与该数据点之间的质心距离最小。 使用这些方法可以计算质心和数据点之间的距离-

- 欧几里德距离: 它是坐标(特征值- 年龄 , 薪水 , BHK公寓 )每个类的数据点和质心。这个公式由毕达哥拉斯定理给出。

![Rendered by QuickLaTeX.com d(x, y)=sqrt[r]{sum_{k=1}^{n}left(x_{k}-y_{k}

ight)^{r}}](https://www.geeksforgeeks.org/wp-content/ql-cache/quicklatex.com-a14e8b581528869d7fabe701df5b4117_l3.png) 其中x是数据点值,y是质心值,k是特征值的数量,例如:给定数据集的k=3

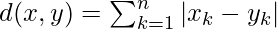

其中x是数据点值,y是质心值,k是特征值的数量,例如:给定数据集的k=3 - 曼哈顿距离: 它被计算为每个类的数据点坐标(特征值)和质心之间的绝对差值之和。

- 闵可夫斯基距离: 这是上述两种方法的推广。如图所示,可以使用不同的值来查找r。

功能扩展的需求: 给定的数据集包含3个特征– 年龄 , 薪水 , BHK公寓 考虑10到60的范围 年龄 ,1个Lac-40个Lac 薪水 ,1-5分 公寓的BHK .所有这些功能都是相互独立的。 假设类别1的质心为[40,22 Lacs,3],要预测的数据点为[57,33 Lacs,2]。

使用曼哈顿方法,

Distance = (|(40 - 57)| + |(2200000 - 3300000)| + |(3 - 2)|)

可以看出,在预测给定数据点的类别时,薪资特征将主导所有其他特征,因为所有特征都是相互独立的,即一个人的薪资与他/她的年龄或他/她对公寓的要求无关。这意味着模型总是预测错误。

所以,这个问题的简单解决方案是特征缩放。特征缩放算法将在固定范围内(比如[-1,1]或[0,1])缩放年龄、薪资和BHK。这样一来,任何功能都无法主宰其他功能。

![关于”PostgreSQL错误:关系[表]不存在“问题的原因和解决方案-yiteyi-C++库](https://www.yiteyi.com/wp-content/themes/zibll/img/thumbnail.svg)